2026/3/7

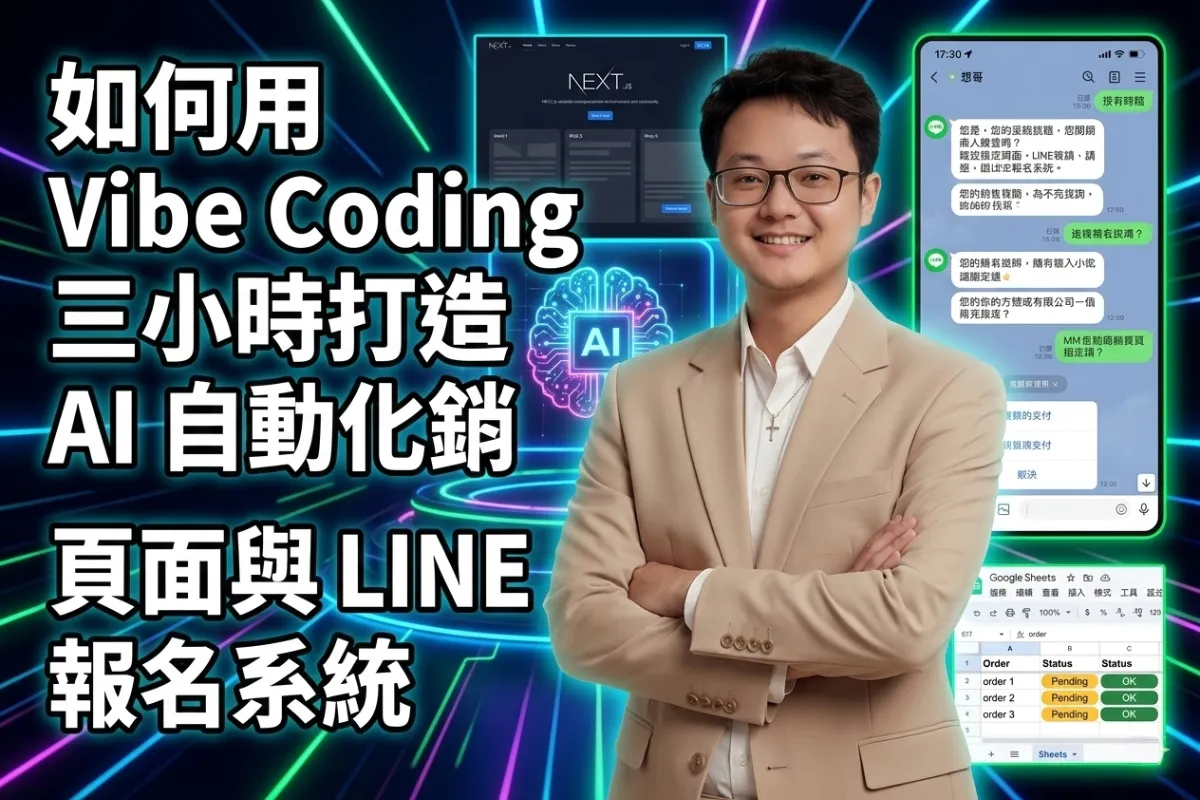

Vibe Coding AI自動化 LINE用 Vibe Coding 打造自動化銷售頁:3小時完成 LINE 報名與 Google Sheets 串接

哈囉,大家好!我是享哥。今天又要來跟大家分享一個全新的 Vibe Coding 課程實作影片。

這次的課程核心,是要帶你透過 AI,在短短 3 小時內,從零開始做出你的第一個「自動化銷售頁(Landing Page)」。你不僅能產出一個可以實際運作的 MVP(最小可行性產品),還能將後端的報名與追蹤流程完全自動化。

3 小時實作:用 AI 寫出你的第一個銷售頁這個課程設計為 6 個核心步驟,將銷售頁的建置、成效追蹤、網站部署,以及 LINE 自動銷售流程完整串接起來。透過 Vibe Coding 的核心概念,你將學會如何利用 AI 輔助開發,實作出高質感的網頁。

課程中使用的前端技術棧包含了現代主流化工具,幫助你快速入門:

Next.js

Tailwind CSS

除此之外,我們還會教你如何設置追蹤像素(Pixel),精準掌握使用者的網頁動線與行為。

零成本部署與自動化 CRM 串接為了讓大家能以極低的成本啟動商業測試,課程會採用幾乎零成本的架構來完成部署與資料串接。

GitHub Pages 輕鬆部署網站我們會將完成的網頁專案,直接部署到 GitHub Pages 上。這不僅免除了昂貴的伺服器主機費用,對於初步測試市場水溫的銷售頁來說,是非常實用且高效的作法。

建立 LINE 自動銷售 CRM當銷售頁準備就緒後,訪客若想報名或購買,我們會引導他們掃描 QR Code,加入 LINE 官方帳號。透過 LINE 機器人,我們能打造一套自動化的客服與銷售系統(CRM)。

實際 Demo:自動化報名與查帳流程以下為你展示當顧客進入 LINE 官方帳號後的實際報名體驗:

觸發報名流程: 顧客輸入關鍵字「報名」或點擊選單,系統會自動跳出報名資訊(包含課程日期、地點、費用等)。

查看價格與匯款: 顧客可以選擇查看「早鳥優惠」、「單人票」或「雙人團報」等方案,並取得匯款帳號。

確認匯款完成: 顧客匯款後,點擊「我已完成匯款」,系統會要求顧客輸入帳號後五碼以利對帳。

Google Apps Script (GAS) 串接 Google Sheets顧客在 LINE 上提交的報名與匯款資訊,會怎麼處理呢?這裡就是自動化最核心的環節。

我們會透過 Google Apps Script (GAS) 撰寫簡單的腳本,將 LINE 收集到的資料自動同步至 Google Sheets 中。你的 Google 試算表就會變成一個強大的後台管理系統。

我們在試算表中設定了多種報名狀態,方便管理者進行後續追蹤:

狀態 (Status)

說明 (Description)

Pending

等待確認中(剛提交匯款資訊)

Confirmed

已核帳,確認收款完成

Notified

已發送報名成功通知給顧客

Refunded

已完成退款

Cancelled

顧客或管理者取消報名

課程的 4 大階段與課前準備為了讓學習更有系統,整個實作過程被拆解為 4 個階段,按部就班幫助你把架構建構起來:

階段 A:先把網站跑起來

目標:先看到畫面,知道你改動程式碼時會發生什麼事。

階段 B:把文案、價格、日期、按鈕換成你的內容

目標:快速做出一個「看起來像你的產品」的專屬頁面。

階段 C:串接 LINE 官方帳號

目標:讓網站的按鈕能真實將顧客引導至你的 LINE 進行互動。

階段 D:串接 GAS 與 Google Sheet

目標:將 LINE 傳來的資料,自動記錄下來並進行狀態管理。

你需要準備的工具帳號要完成這套零成本自動化銷售系統,你只需要事先準備好以下免費帳號:

GitHub 帳號

Google 帳號

LINE 個人帳號

LINE 官方帳號 (Official Account)

常見問答完全不會寫程式,也適合上這堂課嗎?可以。這堂課的設計重點不是要求你先具備完整工程背景,而是帶你透過 AI 輔助,一步一步完成實作。你只需要能跟著操作、願意動手練習,就能做出自己的第一個自動化銷售頁 MVP。

課程中會實際做到哪些成果?你會完成一個可對外展示的銷售頁,並把報名流程串接到 LINE 官方帳號,再透過 Google Apps Script 與 Google Sheets 建立後台資料管理流程。也就是說,從前端頁面、名單收集到匯款回報與狀態追蹤,都會有一套可實際運作的雛型。

這套系統一定要花很多工具費用嗎?不一定。這次課程刻意選擇低成本甚至近乎零成本的工具組合,像是 GitHub Pages、Google Sheets、Google Apps Script 與 LINE 官方帳號,目的就是讓你先快速驗證市場,再決定是否要擴充更進階的商業化流程。

如果我已經有自己的課程或服務,也能套用這套方法嗎?可以,而且很適合。無論你要賣的是線上課程、顧問服務、講座活動、工作坊,甚至是需要先蒐集名單再成交的產品,都可以把這個流程當成基礎骨架,再替換成你的品牌文案、價格方案與報名資訊。

上完課之後,我可以自己修改內容與流程嗎?可以。課程會把整個架構拆成幾個清楚的階段,讓你知道網站內容、按鈕連結、LINE 關鍵字回覆、Google Sheets 欄位與 GAS 腳本之間是怎麼配合的。後續你要換圖片、改價格、調整表單欄位或新增追蹤流程,都會更有方向。

這堂課比較適合哪些人?如果你是想快速驗證產品想法的創業者、想把報名與客服流程自動化的講師或顧問、想練習 AI 協作開發流程的行銷人員,這堂課都很適合。它特別適合想先做出成果,而不是先花很多時間學完整套程式理論的人。

這些看似複雜的流程,在 Vibe Coding 的輔助下,實際上難度並不高。大約只要花費 3 個小時,你就能打造出專屬於你、從網頁前端到資料後台完全串接的自動化系統!

如果你對這個課程、或是對 AI 自動化工作流有興趣,歡迎留言告訴我你的想法,也請務必訂閱關注我,後續我會持續分享更多 Vibe Coding 相關的實作作品與應用技巧!

2026/3/2

AI自動化 影音行銷 Remotion如何使用 Remotion 與 AI 自動化生成科普短影音:喵喵經濟學人

Hello 我是享哥。今天要跟大家分享一套強大的自動化影音工具——Remotion。

如果你還不會安裝 Remotion,非常推薦直接將它的官方網站網址丟給 AI 助手,請 AI 提供安裝指令,就能輕鬆完成基礎環境的建置。

什麼是喵喵經濟學人?解析自動化短影音工作流在環境安裝完畢後,今天要為大家測試網路上討論度極高的專案:「喵喵經濟學人」。

這是一個專門用於自動化製作 9:16 火柴人風格短影片的工具,特別適合用來做心理學與經濟學的科普。它提供了一套非常完整的標準化工作流,涵蓋了以下核心環節:

腳本撰寫

配音生成

畫面繪製

Remotion 影片最終合成

也就是說,只要餵給它故事腳本,系統就能自動生成對應的圖片、文字內容與配音,並一鍵合成完整的短影音。你還能在核心參數中,彈性設定喜歡的音色與圖片風格。

實戰教學:如何用 AI 生成一分鐘經濟學短片?接下來,我將實際演示如何請 AI 產出一支一分鐘的短影音。這支影片的內容,是透過「喵喵經濟學人」來解析美國與以色列對抗伊朗的事件,會如何影響世界經濟。

步驟一:設定故事核心與隱喻腳本首先,我們來到 Antigravity 介面,輸入指令:「Create video 一分鐘短影片,內容是喵喵經濟學人講解美國和以色列攻打伊朗,對於世界經濟的影響」。

系統會開始引用對應的 Skill(記得事前需要先建立好一個 Skill 來引用)。接著,它會根據設定好的核心主題進行創作。為了讓科普內容更生動,系統大量使用了隱喻的方式來呈現國際衝突:

沙漠悍貓國:代表以色列

波斯貓國:代表伊朗

黑色的魚油:代表石油

罐罐通膨與貓薄荷:代表經濟與物價影響

步驟二:API 替代方案與自動生成在語音生成的部分,系統預設使用的是 Minimax 的 API。但因為我目前沒有提供該 API,所以我改用 Edge TTS 來作為語音替代方案,並完成相關的基礎設定。

當 Plan 與 Task 都設定完畢後,系統就會進入生成與處理階段。處理完成後,程式會在 Out 資料夾中將圖片與影片進行完整合成,最終輸出一支完整的短片。

常見問題與解決方案:遇到「全紫畫面」怎麼辦?在自動化生成的過程中,難免會遇到一些突發狀況。

舉例來說,我第一次生成時,合成出的影片竟然是「全紫色」且完全沒有圖片。遇到這種情況我們應該怎麼辦呢?

因為我是使用 Gemini 模型,我的解法是請模型利用 nano banana 去生成影片所需的相關圖片。雖然這個方法沒有辦法一次並行生成所有圖片,系統必須一張一張慢慢排程製作,過程中偶爾也會遇到失敗的情況;但只要耐心等待,它最終會慢慢把腳本裡所有的圖片素材逐一產出。將素材補齊後,就可以順利合併成最終的影片了。

結語以上就是透過 Remotion 程式,串接 AI 自動生成與剪輯影片的完整過程。

今天就跟大家分享介紹到這邊,影片最後我會放上成品給大家參考,有需要的朋友可以繼續往後觀看。想要了解更多 AI 自動化實用工具與工作流應用,歡迎關注並且訂閱我,謝謝大家今天的收看與支持!

2026/1/10

AI自動化 Cursor用 AI 暴力中文化 Cursor 教學網站,並用 GitHub Pages 免費部署

想把一個高品質的英文開源教學站變成繁體中文,以前你要怎麼做?逐行複製程式碼到 Google 翻譯?還是看著螢幕一句句打字?太慢了,這根本是燃燒生命的無效勞動。

目標很明確:把 Cursor for Product Manager 的英文教學站「搬」回來。全站繁體中文化,並且利用 GitHub Pages 免費部署,不用付任何伺服器費用。

核心工具就這幾樣:GitHub、Terminal、AI 模型(GPT-4/Claude/Google 皆可)與編輯器。文末附上原版與繁中版對照連結,不想看過程的可以直接拉到最後。

前置作業:Fork 與 Clone 專案第一步不是翻譯,是把原始碼弄到手。去原始專案的 GitHub 頁面,點擊 Fork。這一步是為了把專案複製到你自己的帳號下,確保你有完全的修改權。

接著把 Fork 後的網址複製下來。打開 Terminal,輸入 git clone 指令把它抓到本地端。用 Cursor 或 VS Code 開啟資料夾,準備開工。

123git clone [https://github.com/你的帳號/repo-name.git](https://github.com/你的帳號/repo-name.git)cd repo-name

AI 翻譯策略:Prompt 文件化技巧很多人用 AI 改 Code 的習慣不好。直接把程式碼貼到對話視窗,效率極低且容易出錯。這裡建議採用 Prompt 文件化 的高階打法。

在專案根目錄建一個 docs 資料夾,或直接新增一個 prompt.md。你要在這個檔案裡,把 AI 當成一個剛入職的資深翻譯。寫清楚角色設定:你是專業 PM、資深譯者。

定義目標受眾是台灣或香港的 PM 與工程師。強調語氣必須是「繁體中文」且「去中國化」。

例如:看到「視頻」要翻成「影片」。

例如:看到「激活」要翻成「啟用」。

執行邏輯:Context 管理與指令下達接著把這個 prompt.md 拖進 AI 的對話視窗(Context)。下達指令:「執行文件內的翻譯任務,將 src/app 下的網站內容中文化」。這樣做的優點是 Context 穩定,不會翻到一半 AI 突然忘記自己是誰。

這裡有個關鍵技巧:指令要兇,權限要給足。

告訴 AI:「請自動完成以下工作,不需要中途確認。」若要處理多個檔案,直接下令「批次翻譯剩餘檔案,不要停下來」。

實戰除錯:應對 AI 幻覺與遺漏當然,AI 目前還不是神,它比較像個會偷懶的實習生。實作過程通常不會一鍵完成,你會遇到幾種狀況。

AI 偷懶: 翻一半就停下來問你「要繼續嗎?」。

解法: 指令要強硬:「不要問我,直接完成所有工作。」

內容遺漏: 特別是側邊欄(Sidebar)這種結構複雜的地方。

解法: 不要用文字描述,直接截圖貼給 AI,讓它自己去對應程式碼位置。

破壞性修改: 有時 AI 翻得太嗨,會把程式碼邏輯也刪了。

解法: 你需要保持警覺,如果發現檔案變小太多,通常就是出事了,請務必 Review diff。

部署流程:Next.js 到 GitHub Pages原專案通常是 Next.js 架構,官方推薦用 Vercel 部署。但為了極致的免費,我們改用 GitHub Pages。直接問 AI:「這是一個 Next.js 專案,教我怎麼部署到 GitHub Pages。」

AI 通常會叫你改 next.config.mjs。加入 output: 'export',讓 Next.js 吐出靜態檔案(Static HTML)。

12345// next.config.mjsconst nextConfig = { output: 'export', // 其他設定...};

注意: 圖片優化元件 <Image> 在靜態匯出時可能會報錯,這部分需視情況調整。

接著請 AI 生成 GitHub Actions 的 workflow 檔案。路徑通常在 .github/workflows/pages.yml。流程不外乎:Checkout code → Setup Node → Build → Upload → Deploy。

123456789101112131415161718192021222324252627282930313233343536373839404142434445464748name: Deploy GitHub Pageson: push: branches: [main] workflow_dispatch:permissions: contents: read pages: write id-token: writeconcurrency: group: pages cancel-in-progress: truejobs: build: runs-on: ubuntu-latest defaults: run: working-directory: website steps: - uses: actions/checkout@v4 - uses: actions/setup-node@v4 with: node-version: 20 cache: npm cache-dependency-path: website/package-lock.json - run: npm ci - run: npm run build - run: touch out/.nojekyll - uses: actions/upload-pages-artifact@v3 with: path: website/out deploy: needs: build runs-on: ubuntu-latest environment: name: github-pages url: ${{ steps.deployment.outputs.page_url }} steps: - id: deployment uses: actions/deploy-pages@v4

收尾與上線:Git 流程與自動化驗收最後就是標準的 Git 流程。

123git add .git commit -m "feat: 完成全站繁體中文化與部署設定"git push origin main

Git push 上去後,到 GitHub Repo 的 “Actions” 分頁看戲。只要燈號全綠,GitHub 就會給你一個網址。原本全英文的介面,現在變成了你專屬的繁體中文版。這不只是翻譯,這是建立了自己的知識庫。

資源傳送門:原版與繁中版對照光看不練沒有用,這裡把資源都整理好了。原版適合練英文,享哥的繁中版適合直接學觀念。想自己動手改的,Repo 連結也都在這,Fork 下去就是你的。

原始教材網站: Cursor for PMs

原始 GitHub: carlvellotti/cursor-pm-course

享哥繁中版網站: Cursor for PMs (繁中版)

享哥繁中 GitHub: chengyunm1313/cursor-pm-course

2025/12/18

AI自動化Canva 自動化實戰:大量證書、聘書一鍵生成工作流

做行政工作最怕什麼?不是難度高,而是重複性高。比如做一百張顧問聘書,或者兩百張學員證書。傳統做法是打開 Word 或 PPT,複製名字、貼上、另存新檔,重複一百次。

如果你還在這樣燃燒生命,那真的太委屈自己了。這種機械式的動作,應該交給機器來做。今天要解構的,就是享哥的「Canva 大量製作」工作流。

必備工具清單這套流程的核心邏輯是「設計」與「資料」分離。你需要以下工具來建構自動化系統:

Canva (建議 Pro 版): 負責皮囊,功能才完整。

Google Sheets: 負責靈魂,用來整理名單資料。

至於底圖素材,現在也不用自己畫了。搭配 AI 生成工具(Gemini、Midjourney 或 Canva 內建),幾秒鐘就能搞定一張具備國際感的底圖。

第一階段:搞定底圖設計 (AI 輔助)首先,我們要準備一張乾淨的「容器」。你可以直接在 Canva 內使用「建立圖像」功能,輸入提示詞。

12直式 A4 尺寸、極簡風格、具國際感的講師聘書設計

選一張順眼的,或者上傳你自己設計好的圖片。如果 AI 生成的圖上有奇怪的亂碼文字,別擔心。使用「編輯圖片」裡的「魔法橡皮擦」或「抓取文字」,把它們擦乾淨即可。

第二階段:建立 Google Sheets 資料庫打開你的 Google Sheets,這裡掌管著所有變數。第一列必須是清楚的標題(Header),這將對應到 Canva 的變數欄位。

12姓名, 職位, 聘期

接著填入所有人員資料。如果是測試流程,也可以請 AI 幫你隨機生成一堆假名單。確認資料無誤後,這份表格就是你的自動化燃料。

第三階段:Canva 排版與變數設定回到 Canva 編輯畫面,按下鍵盤 T 新增文字框。我們要建立三個對應的「佔位符」:講師姓名、職稱、日期。

這裡有個關鍵細節,字體請選最安全的黑體(如 Noto Sans)。把字體大小調整好(例如 88 號字),並拖曳到正確位置。這一步做對了,後面才不會跑版。

第四階段:開啟 Canva「大量建立」功能重頭戲來了,點選 Canva 左側邊欄的「應用程式 (Apps)」,搜尋並開啟 「大量建立 (Bulk Create)」。

系統會問你資料哪裡來,請點選「選取資料來源」。你可以選擇以下兩種方式之一:

直接上傳 CSV 檔。

連結剛剛做好的 Google Sheets。

只要 Canva 讀取到表格,第一關就過了。

第五階段:資料欄位連結 (Connect Data)這是新手最容易卡關,也是最重要的一步。

點選畫布上的「姓名」文字框。

按右鍵(或點選 …),找到 「連結資料 (Connect Data)」 這個選項。

選擇對應的欄位名稱(如:姓名)。

成功後,原本的文字會變成 {姓名} 這種括號格式。依樣畫葫蘆,把「職稱」與「日期」也都綁定好。

第六階段:批量生成與檔案輸出點擊左側面板的「繼續」,確認名單都已勾選,按下 「建立 xx 個設計」。

Canva 會自動彈出一個新分頁,裡面是已經套用好所有名字的幾百頁文件。檢查沒問題後,點擊右上角「分享」→「下載」:

印刷用: 選 PDF 列印。

電子檔: 選 PNG 或 JPG。

實戰防雷小筆記雖然流程簡單,但有幾個坑不要踩:

字體選擇: 如果生成後文字消失或變亂碼,通常是字體不支援,換回通用黑體就對了。

長度預覽: 生成前要確認最長的名字會不會超出邊界。

工具版本: 強烈建議使用 Pro 版帳號。無論是 AI 生成底圖的質感,還是去背修圖的魔法工具,省下的時間絕對超過訂閱費的價值。

把重複的動作自動化,把時間留給更有價值的思考。這才是現代工作者該有的節奏。

2025/12/13

AI自動化 Gemini AI繪圖從咒語到去背全自動:打造你的 LINE 貼圖自動化 AI 生產線

做一套 LINE 貼圖,最痛苦的不是畫不好,而是畫不完。手繪當然有靈魂,但如果你追求的是效率與變現,死磕手繪只會讓你的熱情在第 3 張圖就燃燒殆盡。

這裡要解決的核心問題只有一個:如何利用 AI 工具鏈,快速生成「角色長相統一」且「去背完整」的貼圖包。

我們不需要單一超級工具,我們需要一套組合拳。

工具配置與分工邏輯別指望一個 AI 搞定全部。這是一條迷你生產線,每個環節都要用最強的工具。

大腦擔當:Google Gemini 負責企劃與咒語(Prompt)生成,解決「不知道畫什麼」的卡頓。

繪師擔當:Nano Banana(或任何支援參考圖生圖的工具) 負責實際產出圖片,重點在於「吃參考圖」的能力。

後製擔當:專用貼圖分離去背工具 負責把 AI 生成的大圖切開、去背、加邊框,這是完稿的最後一哩路。

第一階段:企劃與咒語生成系統提示詞 - LINE 貼圖企劃與生圖提示詞專家

不要自己想破頭寫英文 Prompt。直接把你的需求丟給 Gemini,讓它幫你翻譯成繪圖 AI 聽得懂的話。

你需要給 Gemini 明確的「規格書」:

情緒風格(中二、厭世、可愛)

角色設定(姓名、性格、年齡)

張數需求(建議一次設定 9 或 12 張,剛好湊成一張九宮格大圖)

如果不自定義 Gem,直接下指令也行:

1請用附件圖片的角色,製作 12 款 Q 版 LINE 貼圖,動作要生活化、多樣化。

Gemini 會吐出一串包含動作描述的精準英文 Prompt。

Gem:LINE 貼圖企劃與生圖提示詞專家

第二階段:鎖定角色一致性拿到 Prompt 後,轉場到 Nano Banana。這裡最大的挑戰是「角色一致性」(Consistency)。你不能第一張是米老鼠,第二張變成皮卡丘。

操作關鍵在於 「Reference Image」(參考圖)。

輸入 Gemini 給的 Prompt。

同時上傳你設定好的角色原圖。

這能強迫 AI 記住角色的臉和畫風。

按下生成後,你會得到一張包含 9 到 12 個小動作的 Sheet(大圖)。這時候還是連在一起的,別急。

第三階段:切割與參數調校貼圖分離與去背神器

這一步是把「圖片」變成「產品」的關鍵。將生成的大圖丟進「貼圖分離與去背神器」。

參數設定不能憑感覺,這裡有試錯過的黃金數值:

物件間距(Distance):目前範例建議設為 17。太遠會切到別人,太近會留白過多,17 是個甜蜜點。

自動去背(Remove Background):務必開啟。這能省下你用 Photoshop 鋼筆工具摳圖的幾個小時。

第四階段:生死攸關的白邊這點值得單獨拉出來講。在後製設定中,增加白底或白邊(White Stroke)是絕對必要的。

很多人忽略了 LINE 的深色模式(Dark Mode)。如果你的貼圖去背後是深色衣服,又沒加白邊,用戶換個黑色主題,你的貼圖就會直接隱形。

這不是美感問題,是使用者體驗的災難。請確保輸出設定中有包含這一步。

第五階段:品管與補救AI 產出的東西,離完美通常差 10%。你需要進行人工篩選(Quality Control)。

檢查三大地雷:

肢體是否扭曲(AI 不會畫手是常態)。

文字是否亂碼(AI 生成的字通常不能用)。

浮水印(Google 體系常在右下角藏個菱形 Logo)。

用 Canva 或修圖軟體把亂碼蓋掉、把 Logo 修掉。如果肢體崩壞太嚴重,直接捨棄。LINE 貼圖上架單位是 8、16、24 張,湊不齊就回頭再生成一組,與其修爛圖,不如重新抽卡。

最後提醒雖然 AI 讓門檻變低了,但規則還是要守。製作過程雖然全自動,但仍需注意原創性。

不要直接用知名動漫角色的名字或特徵去生成。AI 產圖雖快,但版權意識是你帳號存活的根本。把白邊加好、把圖切好,這套流程就是你的量產武器。

2025/12/11

AI自動化 Gemini別存垃圾格式!用 AI 把 PDF 洗成 Markdown,資料利用率翻倍

PDF 這種檔案格式,閱讀體驗極佳,但要整理或再利用時,簡直是場災難。我們都試過直接複製貼上,或者丟給傳統轉檔工具。結果往往令人崩潰:排版跑位、亂碼橫生、段落碎成一地。

如果你的目標是把資料餵給 AI(如 NotebookLM)或是做成簡報,那你真正需要的,不是「轉檔」,而是把內容清洗成 AI 最懂的 Markdown。這不需要複雜的程式碼,只需要一個懂事的 AI 助手。

這裡的核心工具是 Google Gemini(特別是 Advanced 版更好)。我們要利用它的「Gems(自訂 AI 助手)」功能,把這件事變成一套固定的自動化流程。

建立你的專屬轉檔 Gem別每次都重新下指令,那太沒效率。請依照以下步驟設定你的專屬工具:

直接進到 Google Gemini 右側的「Gem 管理器」。

點選「新增 Gem」。

幫它取個直白的名字,例如「PDF 轉 Markdown 助手」。

接下來的重點在於「使用說明(Prompt)」。千萬不要只寫「幫我轉檔」,那樣你會得到一堆垃圾。你需要植入一套有邏輯的結構化指令。

PDF 轉 Markdown 助手提示詞

設計 Prompt 的核心邏輯想哥特別強調,我們要設計的是「工作流」,而不是單一指令。這套 Prompt 必須包含三個關鍵原則,缺一不可:

內容完整性:確保 AI 不會自作聰明刪減資料。

結構化呈現:指定使用 Markdown 語法。

分階段執行:這點最反直覺,但最重要。不要妄想一步到位,要讓 AI 慢下來。

建議的操作順序為:第一階段,請 AI 先「閱讀並校對」,確認有無錯別字或識別錯誤;確認無誤後,第二階段才進行翻譯(若需要)並輸出繁體中文 Markdown。分兩步走,準確率會大幅提升。

實戰中的除錯技巧:解決引用代碼干擾把 PDF(例如 NVIDIA 的財報)丟進去後,AI 會開始跑流程。但這裡有個 Gemini 目前的小 Bug,很搞人心態。當你直接複製生成的內容時,它會連同「引用來源代碼」一起複製。

貼到筆記軟體時,這些代碼會讓格式再次亂掉。解決方法很粗暴,但很有效。等 AI 生成完,多補一句指令:

1去除資料來源

AI 會乖乖吐出一份乾淨、沒有干擾連結的 Markdown。這時候你再複製,就能得到完美的標題層級與內文。這才是我們要的純淨數據。

Markdown 格式的後續應用槓桿拿到這份乾淨的 Markdown 後,用途就廣了:

最直接的,貼到 NotebookLM 進行更深度的 RAG 分析。

或是利用這些結構化文字,快速轉成 Google Slides 或 PPT。

這個方法的精髓,在於「分段處理」與「格式清洗」。不求快,先求準,最後再把雜質濾掉。把最難搞的 PDF,變成最聽話的素材。

2025/12/9

AI自動化 Gemini 影音行銷AI 影片字幕工作流:結合 Gemini 與剪映的極速上字幕教學

這套流程解決了影片創作者在製作字幕時的三個核心問題:

專業術語準確率:確保 GenAI、LLM、Python 等詞彙不被聽錯。

閱讀體驗優化:自動加中英空格、去除口語贅詞(然後、那個)、符合人眼閱讀的斷句。

極速同步:利用「文稿匹配」功能,免去手動對時間軸的繁瑣過程。

🛠️ 準備工具

剪映 / CapCut 電腦版

Google AI Studio (網頁版,建議使用 Gemini 3 Pro 模型,免費且 Token 上限極高)

步驟一:音頻導出在剪映/CapCut 完成剪輯後,先不要上字幕,執行以下操作:

點選 導出。

僅勾選 「音頻導出」 (格式選 MP3 或 AAC 即可)。

💡 優化點: 處理長影片(超過 30 分鐘)時,建議每 15-20 分鐘切一段導出,避免剪映免費版「文稿匹配」的字數限制。

步驟二:AI 聽寫與校正這是最關鍵的一步。我們不只是要「轉錄」,更是要讓 AI 幫我們「潤飾」。

前往 Google AI Studio。

模型選擇 Gemini 3 Pro。

將導出的 MP3 檔案拖入對話框。

輸入下方的 【提示詞】:

AI 影片字幕提示詞

為什麼這樣設計?

Step 1 術語確認:把 “Notion” 聽成 “Nation” 是不專業的。先讓 AI 問你,只需 30 秒確認,就能保證後面 100% 正確。

斷句控制(優化點):手機直式影片(Reels/Shorts)字幕不宜過長,提示詞中已加入控制,確保閱讀體驗。

💡 使用小撇步

遇到極短音頻(< 3分鐘):Gemini 通常會很有自信,它會直接跳過 Step 1 給您全文,達到「秒出」的效果。

遇到新專案/新主題:如果你這支影片是講一個全新的工具(例如突然要講 “Cursor” 編輯器),您在貼上 Prompt 之後,可以順手在 # Context & Vocabulary 那邊補上 “Cursor” 這個字,這樣一次就會準。

關於「文稿匹配」:複製 AI 輸出的文字後,在剪映中選擇「文稿匹配」時,記得檢查一下第一句是否對齊。只要第一句對了,後面通常 99% 都是準的。

您可以現在就拿一段最近錄製的音檔(或上面那支 YouTube 影片的音頻)去 Google AI Studio 試跑一次,看看效果是否符合您的期待!

步驟三:極速匹配拿到 AI 生成的完美文本後:

複製 AI 輸出的全部文字。

回到 剪映 / CapCut。

點擊 「文本」 -> 「智能文本」 -> 「文稿匹配」。

貼上文字,點擊「開始匹配」。

實測結果: 99% 準確的字幕會自動對齊音軌。

🌟 進階場景分流根據您不同的產出需求,這裡提供兩個分支技巧:

場景 A:製作「雙語字幕」短影音如果您想做像國外科技博主那種中英雙語字幕:

AI 生成 SRT:在 Google AI Studio 完成中文稿後,多加一道指令:

「請將上述內容翻譯成英文,並將兩者合併為 SRT 格式(第一行為中文,第二行為英文)。」

導入剪映:將 AI 生成的代碼存為 .srt 檔,直接拖入剪映。

場景 B:超長課程影片 (>30min)剪映的「文稿匹配」有時對長文本不穩定。

分段處理:如筆記所述,將音頻切成 10-15 分鐘一段。

SRT 暴力解法:如果不想分段,直接請 Gemini 輸出「帶時間軸的 SRT 格式」。

Prompt 補充指令:「請直接輸出 SRT 字幕格式,不需要與我確認術語。」

雖然 Gemini 的時間軸不如專門軟體(如 Whisper)精準到毫秒,但對於說話清晰的教學影片通常夠用,導入後只需微調。

參考文章:

AI 字幕工作流完整教學/提示詞

秒殺剪映的AI字幕工作流!准確率高達99%,完全免費!

2025/12/6

AI自動化 影音行銷 內容行銷自媒體極速工作流:一支影片如何通吃 FB、YT 與部落格?

做自媒體最痛苦的,不是沒靈感,而是你以為寫文章、拍影片、做圖表是三件事。如果你分別去執行,累死是遲早的事。

你需要的是一套「一次產出,無限分發」的邏輯。核心觀念很簡單:抓準一個痛點,錄完一支影片,剩下的全交給 AI。

靈感來源:從學員痛點獲取素材不要坐在電腦前空想,直接從學員的問題、社群的痛點下手,這些就是最真實的需求。

針對這個問題,直接錄製一段教學影片。不用追求完美,重點是把問題講清楚。這支影片,就是接下來所有內容的「母體」。

自動化產線:影片轉文字的高效應用影片錄好了,難道要自己聽打嗎?當然不。透過以下步驟,建立你的自動化產線:

把影片直接丟進 Google AI Studio。

請它幫你整理出詳細筆記。

接著,將這份筆記丟給 Gemini 的「社群文章格式轉換工具」。

社群文章格式轉換工具

轉眼間,一篇結構完整的粉專長文就誕生了。

視覺設計:AI 輔助生成封面與圖表文字搞定,接下來是視覺呈現。同樣利用 Gemini 的 Nano Banana 工具,可以達成以下效果:

資訊圖表:讓它根據內容產出對應的圖表,搭配生成的長文,就是一則高品質的 FB 貼文。12製作資訊圖表,使用台灣繁體中文,日式可愛風格:{{文章內容}}

多尺寸封面:順手生成 16:9 的 YouTube 封面圖,以及 3:2 的部落格封面圖。12345678910你是一位專業的 YouTube 封面設計師,專門幫百萬訂閱頻道製作封面 請參考影片主題,幫我設計一張畫面生動、誇張,使用顯眼綜藝字的封面 影片主題:{{舉例:同學問:開會錄音轉成文案,哪個AI比較好用?}}素材使用:上傳圖片與人物照片 人物照片:請把人物穿搭改成與 AI 工具主題搭配,人物表情則與主題情緒搭配,整體帥氣為主。尺寸:16:9 注意:人物主體與主題要清晰,文字放左邊底部,右下角不要有字。“”“{{影片筆記或粉專長文}}”“”

1圖片尺寸比例調整成3:2,內容自動擴展

松音的Magic Eraser:自動消除圖片中的星星水印電腦王阿達 Nano Banana Watermark Remover

平台發布:YouTube 影音最終組裝回到 YouTube 這條線,使用影片字幕工作流,自動產出 SRT 字幕檔。這是標準化動作,不需要耗費腦力。

最後進行組裝:

解決痛點的原始影片

SRT 字幕

剛剛做好的封面圖

上傳,發布。你的 YouTube 更新完成了。

AI 影片字幕工作流:結合 Gemini 與剪映的極速上字幕教學

內容變現:部落格文章的最後一哩路別浪費那篇寫好的粉專長文。把它丟進 Gemini 的「Hexo Markdown 專家轉換器」,讓 AI 幫你潤飾成適合網站閱讀的格式。

搭配那張 3:2 的封面圖,直接發布到部落格。

結論:一次錄影的工,你已經完成了三個平台的內容佈局。

Hexo Markdown 專家轉換器

常見問答 (FAQ)Q1: 一支影片真的可以同時拿來做 Facebook、YouTube 和部落格內容嗎?可以,前提是你先把影片當成內容母體,再用 AI 將逐字稿或筆記拆解成不同平台需要的格式,像是 FB 長文、YouTube 字幕和 Hexo 文章,這樣就能大幅降低重工成本。

Q2: 影片轉成多平台內容的第一步是什麼?第一步是先把影片上傳到 Google AI Studio 或其他可讀影片內容的工具,整理出結構化筆記或逐字稿,後續所有平台改寫幾乎都建立在這份文字素材上。

Q3: Gemini 在這套多平台內容工作流中扮演什麼角色?Gemini 主要負責格式轉換與內容再製,例如把影片筆記改寫成社群貼文、部落格文章、封面提示詞或資訊圖表需求,讓同一份內容能快速適配不同平台。

Q4: 如果我是個人品牌或小型團隊,這種內容分發流程適合嗎?很適合,因為這套方法本質上是在用 AI 補足人力不足的問題,尤其適合講師、顧問、自媒體經營者與小團隊,把原本要分開完成的文案、字幕與文章整合成同一條生產線。

Q5: 想提升 AI 搜尋或 AEO 表現,文章最後為什麼要加常見問答?因為 FAQ 內容更接近使用者真實提問,搜尋引擎與 AI 系統也更容易理解這是一組可直接引用的問答內容;在這個 Hexo 主題裡,加入可辨識的 FAQ 區塊後,系統還會自動產出對應的 FAQPage JSON-LD。若你想進一步了解實作方式,也可以延伸閱讀 AEO 實作、工具與優化指南。

2025/12/5

AI自動化長會議錄音檔 AI 處理全攻略:突破 100MB 限制的終極解法

錄音檔一長,處理起來就是災難。想要丟進 AI 偷個懶,結果系統第一步就卡關,告訴你檔案太大,請你另請高明。

這時候你需要的不是放棄,而是搞清楚你手上的工具,到底哪一把才切得動這塊肉。

各大 Google AI 工具的真實門檻面對 MP3 這類音訊檔案,你得先看清楚檔案大小,再決定用哪把刀。別拿水果刀去砍大樹。

1. Google Gemini 網頁版這是大家最常用的工具,但限制最嚴格。

單一檔案上限: 100 MB。

實測結果: 182MB 直接報錯,84MB 才能過關。

解法: 如果堅持要用這個介面,唯一的解法就是手動轉檔。把 Bitrate 降到 16kbps,用音質換體積。

2. NotebookLM進階一點的選項,寬容度稍微大一點。

單一檔案上限: 200 MB。

適用場景: 中型檔案。丟進去,直接問答,或者生成摘要。

優勢: 介面友善,還會自動幫你整理筆記,算是不錯的中繼站。

3. Google AI Studio (終極解法)如果你面對的是真正的巨獸,例如好幾個小時的馬拉松會議,前面這兩個工具可能都會吃鱉。這時候,請直上 Google AI Studio。

單一檔案上限: 2 GB。

建議模型: Gemini 3 Pro Preview 或同級模型(支援超長 Context Window)。

實測能力: 影片示範裡,3 小時、182MB 的音檔,它吃得輕輕鬆鬆。

處理超大音檔的標準作業流程當你的錄音檔超過 200MB,或是會議長達數小時,請放棄網頁版對話框。這才是最穩定的路徑。

第一步:前往 Google AI Studio直接前往 Google AI Studio。別走錯棚,這裡才是開發者的後花園,也是一般用戶的強力外掛。

第二步:切換模型在右側或上方選單,確認版本。選 Gemini 2.5 Pro 或最新的 3 Pro Preview,Token 夠大才跑得動。

第三步:上傳檔案點擊那個顯眼的加號,選擇 Upload File。MP3 等主流格式通通支援。

注意: 系統會把檔案暫存到你的 Google Drive。如果上傳失敗,先別罵 AI,去檢查一下你的雲端硬碟是不是爆了。

第四步:下達指令等檔案讀取條跑完,直接在對話框輸入需求。

1幫我生成逐字稿

或者:

1總結會議重點與待辦事項

第五步:執行按下 Run。讓 AI 去跑,你喝口水。分析結果隨後就到。

魔鬼藏在細節裡使用 AI Studio 雖然爽快,但它吃的其實是你的 Google Drive 空間。免費用戶那 15GB 如果滿了,這招一樣行不通。

關於 Token 的消耗量,不用太擔心。

3 小時的音檔大約消耗 36 萬 Tokens。

目前的模型都支援到 100 萬甚至 200 萬。

這意味著,處理半天甚至全天的會議紀錄,這容量是綽綽有餘的。

最後,如果你真的不想切換到開發者介面,還有一個最原始的物理外掛:壓縮音質。對於語音辨識來說,高音質其實是浪費。

轉檔建議把 MP3 降到 32kbps 甚至 16kbps

AI 照樣聽得懂,但檔案大小會顯著縮水。有時候,暴力解法也是一種解法。

參考連結:

Google Gemini 說明

Google AI Studio 格式與限制說明

2025/9/19

Vibe Coding AI自動化解鎖 n8n 網路爬蟲超能力:4 大神級平台與四周實戰攻略

你的 n8n 是不是總覺得少了點什麼?它很強大,像個任勞任怨的數位管家,你叫它做事,它從不抱怨。但你有沒有發現,它有點「內向」?它只能處理你「餵」給它的資訊,卻沒辦法主動「看見」外面那個精彩又混亂的網路世界。

這篇文章,就是要為你這位數位管家,裝上一雙洞察萬物的「眼睛」。我們要談的,就是如何讓 n8n 學會【網路爬蟲】這門手藝。

準備好了嗎?我們將一起解鎖 4 個神級爬蟲平台,並附上一份保證有效的四周實戰地圖,讓你從一個只會按按鈕的使用者,蛻變成一位懂得擷取數據的自動化高手。🚀

認識你的爬蟲武器庫:四大平台深度解析市面上的工具多如牛毛,看得眼花撩亂?別怕。我幫你精挑細選了四款性格迥異、各懷絕技的平台。它們不是競爭對手,而是你在不同戰場上的最佳拍檔。

1. Firecrawl – 網頁內容的「超級整理師」你是否曾受夠了從網頁複製貼上時,格式總是一團亂?Firecrawl 就是來解救你的。把它想像成一位有潔癖的圖書館管理員。你給它一個網址,它會無視所有廣告、側邊欄、彈出視窗,精準地把最重要的「正文」抽出來,然後轉成乾淨到不行的 Markdown 或 JSON 格式。

最適合的戰場: 當你想抓取部落格文章、技術文件、新聞報導這類以「文字」為核心的內容時,找它準沒錯。

如何操作:

在 n8n 的節點庫裡搜尋 “Firecrawl” → 安裝社群節點 → 拖出來後,選擇 “Extract Content” 這個動作,把網址貼進去,搞定。

免費額度: 每個月 500 頁,對個人學習和小型專案來說,綽綽有餘了。

2. Apify – 萬能的「資料瑞士刀」如果說 Firecrawl 是專才,那 Apify 就是個不折不扣的通才。它不是一個工具,它是一個巨大的「工具市集」,裡面有超過 7,000 個由全球開發者寫好的現成爬蟲程式(他們稱為 “Actors”)。想抓 Facebook 粉絲團貼文?有。想抓 YouTube 影片留言?有。想抓 Google Maps 商家評論?它連這個都有!

最適合的戰場: 任何與社群平台、影音網站、電商、搜尋引擎相關的數據,Apify 幾乎都能找到解決方案。

如何操作:

先到 Apify 網站的 Marketplace 找到你要的 Actor → 簡單設定一下參數 → 測試跑一次 → 然後把設定檔 JSON 複製起來,貼到 n8n 的 Apify 節點裡。

免費額度: 每個月提供 $5 美金的用量。很多 Actor 跑一次的費用極低,所以這 $5 夠你玩很久了。

3. RapidAPI – API 的「中央車站」有時候,Apify 的市集也找不到你想要的特定工具。這時候,我們就要去更上游的地方找水。RapidAPI 本身不做爬蟲,但它像一個龐大的百貨公司,匯集了全世界超過 78,000 個 API(應用程式介面)。你可以把它想像成資料的「官方快速通道」,許多服務都會提供 API,讓你能用更穩定、更合法的方式取得資料。

最適合的戰場: 當你需要的是非常即時、格式標準化的資料(例如:最新匯率、Spotify 歌曲資訊、即時新聞頭條),或者 Apify 找不到解決方案時,來這裡挖寶就對了。

如何操作:

在 RapidAPI 網站上找到你要的 API → 在它的測試介面上玩玩看 → 確定沒問題後,網站會幫你產生一段 “cURL” 程式碼 → 把它複製下來,貼到 n8n 的 HTTP Request 節點裡,它會自動幫你轉換成對應的設定。

收費方式: 每個 API 各自為政,但絕大多數都提供佛心的免費方案。

4. BrowserAct – 破解登入關卡的「隱形人」前面三位高手,大多只能在「公開」的網頁上大顯神通。但如果你的目標在公司內部系統、需要登入才能看的論壇,或是那種點了按鈕才會跳出內容的動態網頁呢?這時候,就需要我們的偽裝大師:BrowserAct。它不是直接抓程式碼,而是「模擬」一個真人在操作瀏覽器,你可以透過視覺化的節點,教它如何輸入文字、點擊按鈕、等待、滾動頁面。

最適合的戰場: 需要登入、Cookie 驗證、或複雜互動才能取得資料的「封閉環境」。

如何操作:

直接在 BrowserAct 的網站上,用拖拉節點的方式設計你的爬蟲流程 → 設計完畢後,你可以讓它獨立運作,或者透過 API/Webhook 的方式與 n8n 串接,觸發執行。

免費額度: 每天登入就送 500 點,每次操作會扣點數。對於小規模的內部提醒來說,相當夠用。

一張圖秒懂,你該選哪一把武器?還不確定?沒關係,這張表幫你做了個弊。

工具 / 平台

功能特色(一句話點評)

收費方式

適合情境

Firecrawl

潔癖整理師,專門把網頁文章變乾淨

每月免費 500 頁

讀書筆記、技術文件、文章重點整理

Apify

資料界的瑞士刀,社群影音電商一把抓

每月 $5 額度

社群輿情監控、影音資料收集、市場價格追蹤

RapidAPI

API 的百貨公司,尋找官方資料的捷徑

各 API 不同,多有免費額度

需要即時、標準化資料的自動化流程

BrowserAct

隱形人,能潛入需要登入的網站系統

每日送點數,依操作計費

公司內部系統公告、需要會員身份的資料抓取

Scrapy (Python)

重型坦克,為大規模、高訂製化爬蟲而生

完全免費 (但主機要錢)

需要長期、大量、深度爬取資料的專業專案

Playwright

最佳演員,完美模擬真人瀏覽器互動

完全免費

對付超高難度的動態網站、反爬蟲機制強的網站

提醒: Scrapy 和 Playwright 是更底層的 Python 爬蟲框架,可以讓你做到 100% 的客製化,但需要寫程式碼。在我們的學習路線圖中,它們會是你的「畢業挑戰」。

n8n 網路爬蟲起手三式理論說完了,該來點實際的。這裡提供三個由簡到難的 n8n 爬蟲範例,讓你感受一下它們的威力。

第一式:陽春麵作法 (Http Request + AI)這是最基礎的玩法,完全不用外部工具。流程: 用 Http Request 節點抓整個網頁的 HTML 原始碼 → 把亂七八糟的碼丟給 AI 節點 → 請 AI 大力出奇蹟,幫你「閱讀」並提取出正文。致命缺點: 稍微複雜一點的「動態網站」(內容由 JavaScript 生成),這招會直接失效,因為它抓不到最終顯示給你看的內容。

第二式:書生劍法 (Firecrawl 節點)這是處理文章類內容的優雅解法。流程: 用 Firecrawl 節點的 “Extract Content” → 它會直接回傳乾淨的 Markdown 格式內文 → 把這些乾淨的文字交給 AI 節點 做摘要、抓關鍵字,或是存入 Notion。優勢: 簡單、穩定、效果極好,是建立自動化知識庫的神器。

第三式:百寶袋戰法 (Apify 節點)這是應對社群媒體的標準答案。流程: 在 Apify 網站上設定好你要的爬蟲(例如:YouTube 頻道影片資料爬蟲)→ 把它的設定 JSON 複製到 n8n 的 Apify 節點 → 執行後,它就會回傳結構化的資料(影片標題、觀看數、發布日期等),方便你存入 Google Sheet 做分析。優勢: 不用自己煩惱如何解析複雜的社群網站,讓專業的來。

網路爬蟲的法律紅線:這樣做合法嗎?這是每個新手都一定會問,也必須問的問題。

Q1:我這樣爬取資料,會觸法嗎?放輕鬆,絕大多數情況下不會。但你必須建立一個「紅線」觀念。

✅ 綠燈區 (請安心服用):

公開資訊: 任何人不用登入就能看到的網頁內容。

官方 API: 這是對方「邀請」你來拿資料,最安全。

自家資料: 爬自己公司的內部系統當然沒問題。

❌ 紅線區 (千萬別碰):

會員限定內容: 需要付費或特定身份才能看的文章、影片。

受版權保護的內容: 未經授權,把別人辛苦寫的電子書、付費課程內容整個搬下來。

造成對方伺服器癱瘓: 在極短時間內發動海量請求,這跟駭客的 DDoS 攻擊沒兩樣。

Q2:如何成為一位「有禮貌」的爬蟲使用者?這很重要,決定了你的爬蟲之路能走多遠。

閱讀公開說明書: 檢查網站的 robots.txt 檔案 (例如 google.com/robots.txt) 和服務條款 (ToS),看看對方是否歡迎爬蟲。

官方管道優先: 能用 API,就絕不用爬蟲。

表明身份與降低頻率: 在你的請求中設定 User-Agent,假裝自己是個正常的瀏覽器。並且拉長每次請求的間隔時間,例如每 3-5 秒才抓一次。

非商業用途: 如果只是個人學習或研究,風險極低。但若要商業化使用,務必仔細檢查資料授權。

Q3:為什麼我的爬蟲跑一跑就被擋了?通常是你看起來「太不像真人」了。

原因一:頻率太高。 (解法:n8n 加個 Wait 節點,每次都等幾秒)

原因二:沒有瀏覽器特徵 (Header)。 (解法:在 Http Request 節點裡手動加上)

原因三:IP 來源太單一。 (解法:進階技巧,使用「代理伺服器 (Proxy)」)

終極解法: 使用 Playwright 或 BrowserAct 這類工具,它們是最好的演員,能完美模擬真人操作。

你的「n8n 爬蟲煉金術」四周實戰地圖光說不練假把戲。跟著這份為期四周的計畫,一步步從麻瓜變魔法師。

第 1 週:打好基礎,成為文章整理大師

核心工具: n8n + Firecrawl

本週作業:

建立一個工作流:每天自動爬取一篇你指定的技術部落格文章。

將爬下來的 Markdown 內容,交給 AI 節點,自動生成 300 字的摘要和 5 個關鍵字。

最後,將原文連結、摘要、關鍵字,一起存入你的 Notion 資料庫。

達成目標: 打造一個全自動化的個人知識庫。

第 2 週:深入社群,變身數據分析師

核心工具: n8n + Apify

本週作業:

挑一個你喜歡的 YouTube 頻道,用 Apify 爬取該頻道最新的 20 支影片資料(標題、觀看數、喜歡數、發布時間)。

將這些結構化資料,自動寫入 Google Sheet。

挑戰題: 試著抓取一個公開 Facebook 粉絲專頁的最新貼文,分析哪種類型的貼文互動最高。

達成目標: 建立一個社群數據的自動化追蹤儀表板。

第 3 週:解鎖 API 與登入高牆

核心工具: n8n + RapidAPI + BrowserAct

本週作業:

RapidAPI 任務: 找一個免費的新聞 API,設定一個工作流,每小時去抓取最新的科技新聞頭條,並發送到你的 Slack 或 Discord。

BrowserAct 任務: 設計一個流程,模擬登入自己公司的內部公告系統,檢查是否有「重要」或「緊急」等關鍵字,若有,則立刻發送通知到手機。

達成目標: 掌握串接外部服務與處理內部系統的能力。

第 4 週:挑戰大魔王,踏入程式領域

核心工具: Python (BeautifulSoup / Playwright)

本週作業:

BeautifulSoup 挑戰: 試著用 Python 寫一小段程式,解析一個靜態新聞網站,並只印出所有新聞的標題。

Playwright 挑戰: 挑戰爬取一個動態加載的電商網站(例如 PChome),成功抓取第一頁所有商品的「名稱」與「價格」。

終極目標: 將你寫好的 Python 腳本,透過 n8n 的 Execute Command 節點來定時觸發,實現完全體的自動化爬蟲專案。

達成目標: 跨越無程式碼的界線,理解爬蟲的底層原理,未來沒有網站能難倒你。

結論:你將成為數據的主宰者當你完成這四周的修煉,你會驚訝地發現:

你的 Notion 不再是個需要手動剪貼的倉庫,而是一個能自我成長的【智慧知識庫】。你的 Google Sheet 不再是冰冷的表格,而是一個即時跳動的【社群數據心電圖】。你不再被動地接收資訊,而是能主動出擊,打造專屬於你的【新聞收集器】與【內部預警系統】。

更重要的是,你為自己打下了最堅實的【數據基礎】。在這個 AI 時代,懂得如何穩定、自動地獲取高品質的資料,將是你最無可取代的核心競爭力。

現在,動手打開你的 n8n 吧。這個充滿數據寶藏的世界,正等著你去探索。🚀